AI 보안 전문기업 에임인텔리전스(AIM Intelligence, 대표 유상윤)는 국내 최대 규모의 AI 보안 행사 ‘2025 해킹방어대회(AI Cyber Defence Contest, 2025 ACDC)’에 공식 참여해 AI 해킹방어대회 문제 출제기관 및 세미나 모더레이터 역할을 수행했다고 3일 밝혔다.

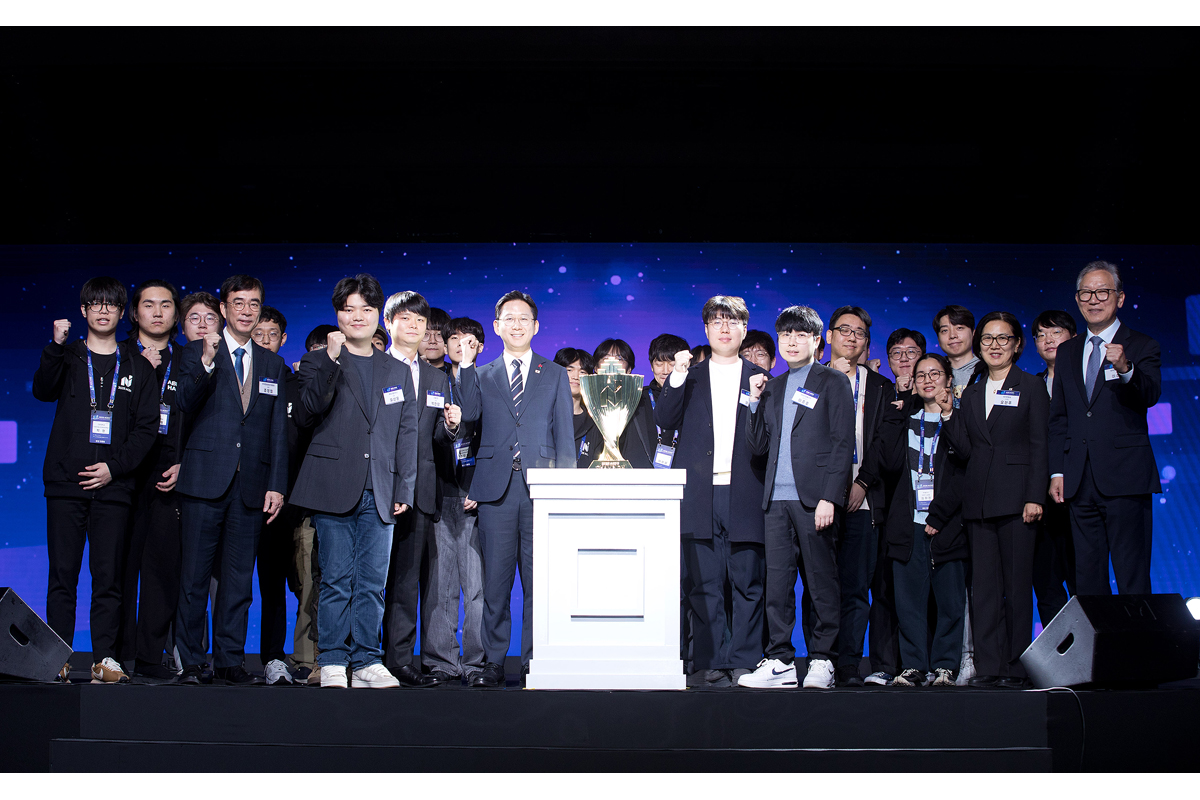

과학기술정보통신부가 주최하고 한국인터넷진흥원(KISA)과 한국정보보호산업협회(KISIA)가 주관한 이번 행사는 ‘AI for All, Security for All’을 슬로건으로 ▲AI 보안 Insight 세미나 ▲AI 해킹 방어대회 본선 ▲AI 보안 기술 전시 등 다양한 프로그램으로 구성됐다.

에임인텔리전스는 특히 대회의 핵심 프로그램인 ‘Security for AI’ 영역과 ‘AI 해킹 공방전’ 전 문제 출제 및 기술 검수를 담당했다. 이번 출제 범위는 텍스트 기반 LLM 취약점을 넘어 멀티모달·에이전트 기반 AI 시스템에서 발생 가능한 실전형 위협 시나리오로 확장됐다.

대회의 하이라이트인 ‘AI 해킹 공방전’에서는 참가 팀이 직접 가드레일과 AI 시스템을 구축한 뒤 상대 팀의 시스템을 실시간으로 공격·방어하는 방식이 적용됐다. 이를 통해 참가자들은 실제 산업 환경의 공격·방어 경쟁을 단기간에 체험하며 대응 역량을 검증했다.

출제된 문제는 시각적 적대 입력을 통해 AI 드론을 오작동하게 만드는 공격, 에이전트용 허니팟 설계, 자동 멀티턴 탈옥 공격 수행 에이전트 개발, 자율 시스템을 잘못된 방향으로 조종하도록 유도하는 시나리오, 개인키 탈취형 데이터 유출 공격, 제한된 내부 도구 호출을 강제해 민감 정보를 추출하는 공격 등으로 구성됐다.

에임인텔리전스 관계자는 “멀티모달·에이전트 기반 AI 서비스에서 실질적으로 발생 가능한 위험을 반영해 문제를 설계했다”고 설명했다.

한편 행사 첫날, 유상윤 대표는 ‘AI 보안 Insight 세미나’의 공식 모더레이터로 참여해 글로벌 기업 및 기관의 AI 도입 과정에서 제기되는 보안 이슈와 최신 동향을 소개하고 연사들과의 논의를 이끌었다.

에임인텔리전스는 인공지능안전연구소(AISI), 금융보안원, 한국신용정보원 등과 함께 AI 보안 표준화 연구 및 기술 협력을 진행 중이며, OpenAI의 로컬 AI 세이프티(Local AI Safety) 파트너로서 글로벌 협력도 강화하고 있다.

유상윤 대표는 “국가 차원의 AI 보안 생태계 강화에 기여할 수 있어 의미가 크다”며 “멀티모달·자율 에이전트 영역까지 확장되는 위협에 대응하기 위한 기술 개발을 가속화하겠다”고 말했다.

- 관련 기사 더 보기

Aim Intelligence Officially Participates in the 2025 Hacking Defense Competition

AI security specialist AIM Intelligence (CEO Sang-yoon Yoo) announced on the 3rd that it officially participated in the '2025 AI Cyber Defense Contest (2025 ACDC)', the largest AI security event in Korea, and served as a problem setter and seminar moderator for the AI hacking defense contest.

Hosted by the Ministry of Science and ICT and organized by the Korea Internet & Security Agency (KISA) and the Korea Information Security Industry Association (KISIA), this event, with the slogan of 'AI for All, Security for All,' consisted of various programs such as ▲AI Security Insight Seminar ▲AI Hacking Defense Contest Finals ▲AI Security Technology Exhibition.

Aim Intelligence was particularly responsible for creating questions and reviewing the technical aspects of the contest's core programs, "Security for AI" and "AI Hacking Battle." This year's questions expanded beyond text-based LLM vulnerabilities to encompass real-world threat scenarios that could arise in multimodal, agent-based AI systems.

The highlight of the competition, the "AI Hacking Battle," involved teams building their own guardrails and AI systems, then attacking and defending the opposing team's systems in real time. This allowed participants to quickly experience the attack-defense competition of a real-world industrial environment and test their response capabilities.

The presented problems consisted of an attack that causes AI drones to malfunction through visual adversarial inputs, designing a honeypot for an agent, developing an agent that performs an automatic multi-turn jailbreak attack, a scenario that induces an autonomous system to steer in the wrong direction, a data exfiltration attack that steals private keys, and an attack that extracts sensitive information by forcing the call of limited internal tools.

An Aim Intelligence representative explained, “We designed the problem to reflect the risks that can actually occur in multimodal, agent-based AI services.”

Meanwhile, on the first day of the event, CEO Yoo Sang-yoon participated as the official moderator of the 'AI Security Insight Seminar', introducing security issues and the latest trends that arise during the AI adoption process of global companies and organizations, and leading discussions with the speakers.

Aim Intelligence is conducting AI security standardization research and technology collaboration with the Artificial Intelligence Security Institute (AISI), the Financial Security Institute, and the Korea Credit Information Services, and is also strengthening global cooperation as an OpenAI Local AI Safety partner.

CEO Yoo Sang-yoon said, “This is very meaningful as it can contribute to strengthening the AI security ecosystem at the national level,” and added, “We will accelerate the development of technologies to respond to threats that expand to the multimodal and autonomous agent areas.”

- See more related articles

エイムインテリジェンス、「2025ハッキング防御大会」公式参加

AIセキュリティ専門企業エイムインテリジェンス(AIM Intelligence、代表ユ・サンユン)は、国内最大規模のAIセキュリティイベント「2025ハッキング防御大会(AI Cyber Defence Contest、2025 ACDC)」に公式参加し、AIハッキング防御大会問題出題機関とセミナーモデレーターの役割を果たした。

科学技術情報通信部が主催し、韓国インターネット振興院(KISA)と韓国情報保護産業協会(KISIA)が主管した今回のイベントは「AI for All, Security for All」をスローガンに▲AIセキュリティ Insightセミナー▲AIハッキング防御大会本選▲AIセキュリティ技術展示など多様なプログラムで構成された。

エイムインテリジェンスは特に大会の中核プログラムである「Security for AI」領域と「AIハッキング攻防戦」前問題出題および技術検収を担当した。今回の出題範囲は、テキストベースのLLM脆弱性を超え、マルチモーダル・エージェントベースのAIシステムで発生可能な実戦型脅威シナリオに拡張された。

大会のハイライトである「AIハッキング攻防戦」では、参加チームが直接ガードレールとAIシステムを構築した後、相手チームのシステムをリアルタイムで攻撃・防御する方式が適用された。これにより、参加者は実際の産業環境の攻撃・防御競争を短期間に体験し、対応能力を検証した。

出題された問題は、視覚的敵対入力を通じてAIドローンを誤作動させる攻撃、エージェント用ハニーポット設計、自動マルチターン脱獄攻撃を行うエージェント開発、自律システムを間違った方向に操縦するように誘導するシナリオ、秘密鍵脱臭型データ流出攻撃、制限された内部ツール呼び出しを強制して機密情報を抽出する攻撃などで構成された。

エイムインテリジェンス関係者は「マルチモーダル・エージェントベースのAIサービスで実質的に発生可能なリスクを反映して問題を設計した」と説明した。

一方、イベント初日、ユ・サンユン代表は「AIセキュリティ Insightセミナー」の公式モデレーターとして参加し、グローバル企業や機関のAI導入過程で提起されるセキュリティ問題と最新動向を紹介し、講師たちとの議論を導いた。

エイムインテリジェンスは人工知能安全研究所(AISI)、金融保安院、韓国信用情報院などとともにAIセキュリティ標準化研究および技術協力を進めており、OpenAIのローカルAIセーフティ(Local AI Safety)パートナーとしてグローバル協力も強化している。

ユ・サンユン代表は「国家レベルのAIセキュリティエコシステムの強化に寄与でき、意味が大きい」とし「マルチモーダル・自律エージェント領域まで拡張される脅威に対応するための技術開発を加速する」と話した。

- 関連記事をもっと見る

Aim Intelligence正式参加2025年黑客防御大赛

AI 安全专家 AIM Intelligence(CEO 柳相允)于 3 日宣布,公司正式参加韩国最大的 AI 安全活动“2025 AI 网络防御大赛(2025 ACDC)”,并担任 AI 黑客防御大赛的出题人和研讨会主持人。

本次活动由韩国科学技术信息通信部主办,韩国互联网安全振兴院(KISA)和韩国信息安全产业协会(KISIA)承办,以“人人享有人工智能,人人享有安全”为口号,包含多种项目,如▲人工智能安全洞察研讨会▲人工智能黑客防御大赛决赛▲人工智能安全技术展览。

Aim Intelligence 主要负责为竞赛的核心项目“人工智能安全”和“人工智能黑客大战”创建题目并审核其技术方面。今年的题目不再局限于基于文本的LLM漏洞,而是涵盖了多模态、基于代理的人工智能系统中可能出现的真实威胁场景。

本次大赛的亮点是“人工智能黑客大战”,参赛队伍需要自行搭建防护系统和人工智能系统,然后实时攻击和防御对方的系统。这使得参赛者能够快速体验真实工业环境下的攻防对抗,并检验自身的应对能力。

所提出的问题包括:通过视觉对抗输入导致 AI 无人机发生故障的攻击;为代理设计蜜罐;开发执行自动多轮越狱攻击的代理;诱使自主系统朝错误方向行驶的场景;窃取私钥的数据外泄攻击;以及通过强制调用有限的内部工具来提取敏感信息的攻击。

Aim Intelligence 的一位代表解释说:“我们设计这个问题是为了反映多模态、基于代理的 AI 服务中实际可能出现的风险。”

与此同时,在活动的第一天,CEO Yoo Sang-yoon 以“AI 安全洞察研讨会”官方主持人的身份出席,介绍了全球公司和组织在采用 AI 过程中出现的安全问题和最新趋势,并与演讲者进行了讨论。

Aim Intelligence 正在与人工智能安全研究院 (AISI)、金融安全研究院和韩国信用信息服务公司开展人工智能安全标准化研究和技术合作,并作为 OpenAI 本地人工智能安全合作伙伴加强全球合作。

CEO Yoo Sang-yoon 表示:“这意义重大,因为它有助于加强国家层面的人工智能安全生态系统。”他还补充道:“我们将加快技术开发,以应对扩展到多模式和自主代理领域的威胁。”

- 查看更多相关文章

Aim Intelligence participe officiellement au concours de défense contre le piratage informatique 2025

Le spécialiste de la sécurité en IA AIM Intelligence (PDG Sang-yoon Yoo) a annoncé le 3 qu'il participait officiellement au « 2025 AI Cyber Defense Contest (2025 ACDC) », le plus grand événement de sécurité en IA en Corée, et qu'il servait de concepteur de problèmes et de modérateur de séminaire pour le concours de défense contre le piratage en IA.

Organisé par le ministère des Sciences et des TIC et par l'Agence coréenne de l'Internet et de la sécurité (KISA) et l'Association coréenne de l'industrie de la sécurité de l'information (KISIA), cet événement, placé sous le slogan « L'IA pour tous, la sécurité pour tous », comprenait divers programmes tels que : ▲Séminaire sur les perspectives de la sécurité de l'IA ▲Finale du concours de défense contre le piratage de l'IA ▲Exposition des technologies de sécurité de l'IA.

Aim Intelligence était notamment responsable de la création des questions et de l'examen des aspects techniques des programmes principaux du concours, « Sécurité pour l'IA » et « Bataille de piratage d'IA ». Les questions de cette année se sont étendues au-delà des vulnérabilités LLM textuelles pour englober des scénarios de menaces réels pouvant survenir dans des systèmes d'IA multimodaux basés sur des agents.

L'épreuve phare du concours, la « Bataille de piratage IA », consistait à faire concevoir aux équipes leurs propres garde-fous et systèmes d'IA, puis à attaquer et défendre les systèmes de l'équipe adverse en temps réel. Cela a permis aux participants de se familiariser rapidement avec les stratégies d'attaque et de défense propres à un environnement industriel réel et de tester leurs capacités de réaction.

Les problèmes présentés consistaient en une attaque provoquant le dysfonctionnement de drones IA par le biais d'entrées adverses visuelles, la conception d'un pot de miel pour un agent, le développement d'un agent effectuant une attaque de jailbreak automatique en plusieurs étapes, un scénario incitant un système autonome à prendre la mauvaise direction, une attaque d'exfiltration de données volant des clés privées et une attaque extrayant des informations sensibles en forçant l'appel d'outils internes limités.

Un représentant d'Aim Intelligence a expliqué : « Nous avons conçu le problème pour refléter les risques qui peuvent réellement survenir dans les services d'IA multimodaux basés sur des agents. »

Par ailleurs, lors de la première journée de l'événement, le PDG Yoo Sang-yoon a participé en tant que modérateur officiel du « Séminaire sur les enjeux de sécurité de l'IA », présentant les problèmes de sécurité et les dernières tendances qui émergent lors du processus d'adoption de l'IA par les entreprises et organisations du monde entier, et animant des discussions avec les intervenants.

Aim Intelligence mène des recherches sur la normalisation de la sécurité de l'IA et une collaboration technologique avec l'Artificial Intelligence Security Institute (AISI), le Financial Security Institute et le Korea Credit Information Services, et renforce également sa coopération mondiale en tant que partenaire local d'OpenAI pour la sécurité de l'IA.

Le PDG Yoo Sang-yoon a déclaré : « C’est très important car cela peut contribuer à renforcer l’écosystème de sécurité de l’IA au niveau national », et a ajouté : « Nous allons accélérer le développement de technologies pour répondre aux menaces qui s’étendent aux domaines des agents multimodaux et autonomes. »

- Voir plus d'articles connexes

You must be logged in to post a comment.