“인간의 풍요로운 생활과 업무의 효율을 도울 수 있는 딥러닝 기술들이 보다 빠르게 실생활과 현업에 적용될 수 있어야 한다고 생각했습니다.”

채명수 대표는 노타의 온디바이스 AI 솔루션 개발 계기를 위와 같은 명확한 한 마디로 표현했다. KAIST 대학원 졸업 후 노타 창업 직전까지 KAIST 인공지능연구소의 초기 멤버로 있었다는 그는 연구소에서의 업무들이 충분히 가치가 있었으나 실생활과는 다소 거리가 있는 선행 연구에 가까웠기 때문에, 보다 적성에 맞는 실용적인 일을 하기 위해 창업의 길로 들어서게 되었다고 말했다. 그러다 보니 실생활 또는 현업에서 바로 적용될 수 있는 기술과 제품을 항상 염두에 두며 사업을 개진하고 있다고.

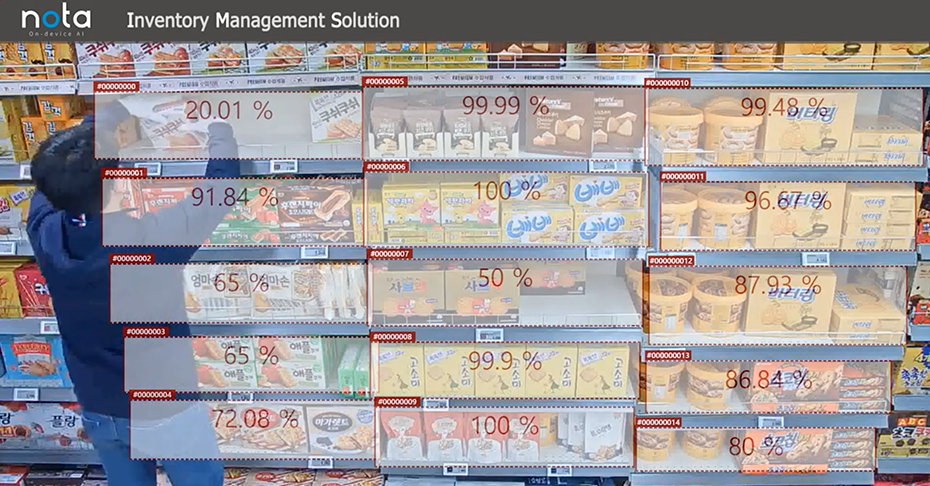

딥러닝 기술이 빠르고 효율적으로 실생활에 적용되기 위해서는 고성능 AI 기술의 다양한 제약, 예를 들면 높은 클라우드와 서버 구축 및 유지 비용, 프라이버시 이슈(보안 문제), 통신 필수 등의 제약들을 해소할 수 있어야 한다. 이 과정에서 필요한 핵심 기술이 바로 딥러닝 모델 경량화와 압축 기술. 노타는 이 기술을 기반으로 여러가지 제약을 해소한 온디바이스 AI(On-Device AI)를 실현하였고 그 범위를 점차 확장하고 있다.

기존 AI 기반 서비스나 제품들은 대부분 고성능 연산장치인 서버나 클라우드를 기반으로 하고 있기 때문에 스마트폰, 소형 IoT 기기 등의 개별 디바이스에서 구동하기에는 어려움이 있다. 또한 통신이 없는 지역에서 사용이 불가능하고 높은 운영 비용이나 보안 이슈 등의 문제가 발생하기도 한다. 채명수 대표는 노타가 AI 모델 경량화 원천 기술을 통해 이러한 문제를 해결하고 있다고 설명한다.

AI 모델 경량화란 개별 저전력, 저사양 기기에서도 구동될 수 있도록 복잡한 AI 모델을 성능 저하 없이 경량화 하는 기술을 말한다. 노타의 AI 자동 경량화 플랫폼인 ‘넷츠프레소(NetsPresso)’는 단기간에 경량화된 최적의 AI 모델을 만들 수 있다는 것이 채 대표의 설명. 또한 이를 통해 실제 모델이 구동되는 디바이스에 탑재될 정도로 경량화된 AI 모델을 제공할 수 있다. 이렇게 저비용으로 빠르고 정확한 AI 모델을 만들 수 있다는 것이 노타 기술의 차별점.

이렇게 차별화된 기술력을 바탕으로 크게 성장하고 있는 노타. 노타에 따르면 2019년 3분기와 2020년 3분기를 비교했을 때 약 2.6배 이상 인력이 빠르게 확장되었다. 특별히 R&D 부문의 인력을 대거 확충하면서 시장의 수요에 대비하고, 경쟁력을 강화하는데 주력하고 있다. 매출 역시 2019년 대비 2020년에 약 4배 이상 성장하고 있다고.

또한 노타는 SKT, Intel, Nvidia, Microsoft, 삼성 SDS, LG CNS 등을 포함한 국내외 20개 이상의 기업과 파트너십을 맺고 있으며, 특히 올해까지 30개 이상의 NDA/MOU를 채결하고 다양한 산업에 노타의 기술을 적용한 PoC를 진행 중이다.

채명수 대표는 특히 SKT와의 협업에 대해 언급했다.

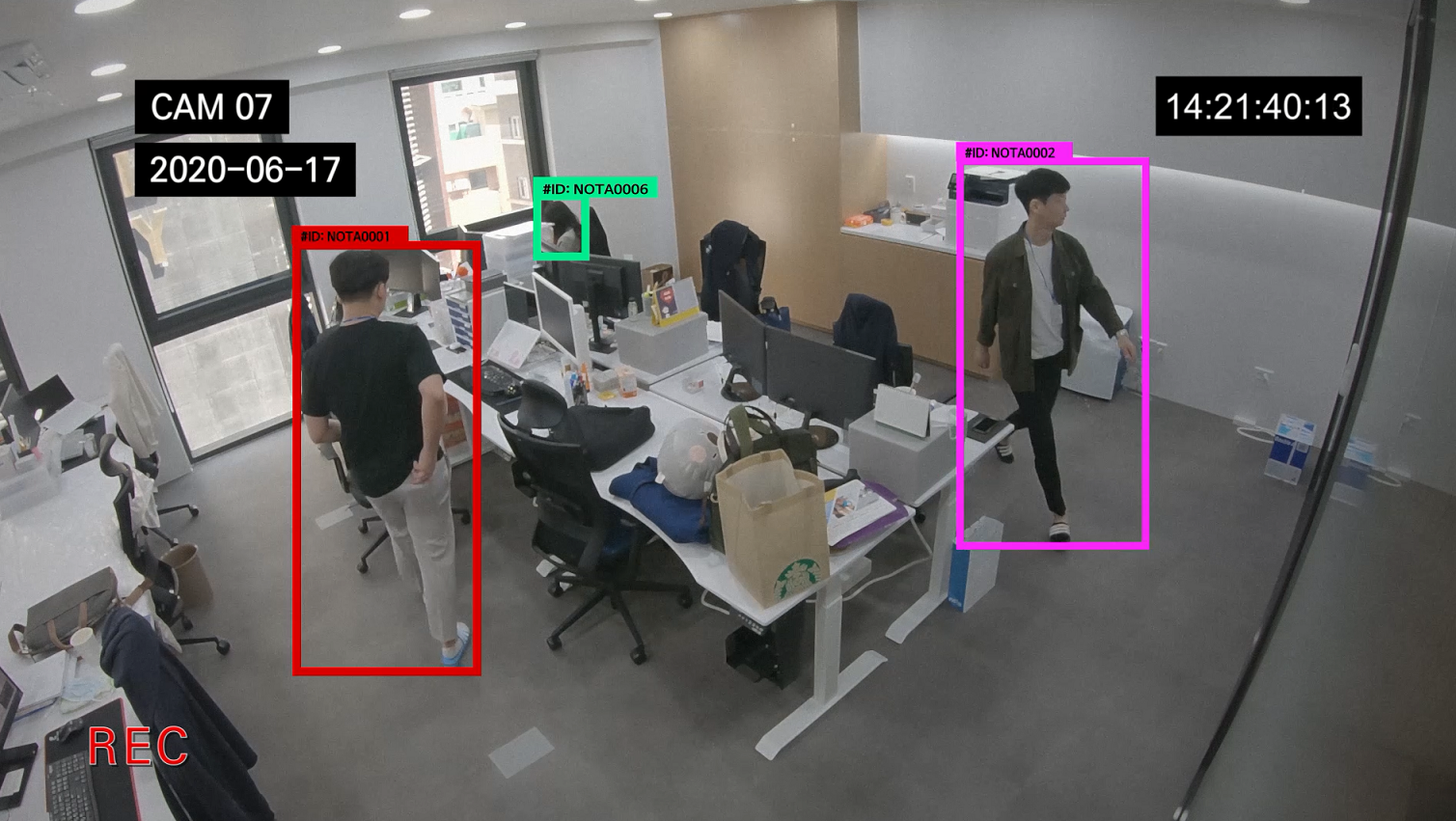

“노타는 SKT와 의미 있는 파트너십을 위한 노력을 진행 중입니다. 노타의 경량화 기술로 SK텔레콤에서 활용하고 있는 여러 AI 모델들을 디바이스에서 상용화하는 방안을 모색하고 있습니다. 특히 영상 인식에서 모빌리티, Surveilance 등의 분야에 있어 협력 방안을 모색하고 있으며, SKT 측에서는 전사 공지로 노타를 홍보하는 등 사업부와 노타가 직접 협력할 수 있도록 도움을 주고 있습니다. 앞으로 노타가 보유한 AI 모델 경량화 원천 기술이 SKT의 서버 경량화, network traffic 감소 등의 측면에 적극 활용되길 희망합니다.”

마케팅에서도 트렌디하고 진심을 담은 다양한 방법을 모색 중이라는 노타. 노타의 서비스를 직접적으로 사용하고 있거나 잠재 고객인 기업들에게뿐만 아니라 노타의 기술에 크고 작은 관심을 가지고 있는 모든 분야의 사람들을 위해 한 달에 한 번 뉴스레터를 만들어 전하고 있다는 노타의 열정이 노타만의 온디바이스 AI 솔루션을 만나 앞으로의 더 큰 성장을 이루어 내길 기대해 본다.

You must be logged in to post a comment.