Le spécialiste de la sécurité en IA AIM Intelligence (PDG Sang-yoon Yoo) a annoncé le 3 qu'il participait officiellement au « 2025 AI Cyber Defense Contest (2025 ACDC) », le plus grand événement de sécurité en IA en Corée, et qu'il servait de concepteur de problèmes et de modérateur de séminaire pour le concours de défense contre le piratage en IA.

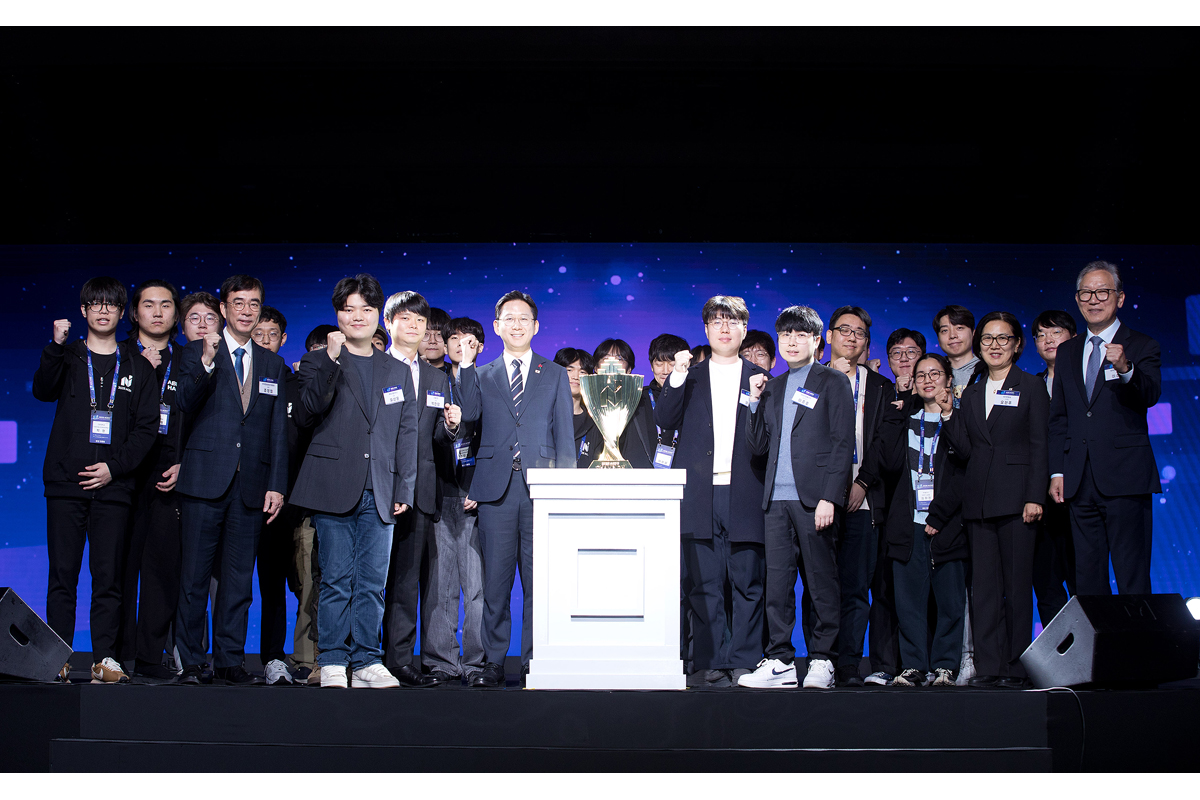

Organisé par le ministère des Sciences et des TIC et par l'Agence coréenne de l'Internet et de la sécurité (KISA) et l'Association coréenne de l'industrie de la sécurité de l'information (KISIA), cet événement, placé sous le slogan « L'IA pour tous, la sécurité pour tous », comprenait divers programmes tels que : ▲Séminaire sur les perspectives de la sécurité de l'IA ▲Finale du concours de défense contre le piratage de l'IA ▲Exposition des technologies de sécurité de l'IA.

Aim Intelligence était notamment responsable de la création des questions et de l'examen des aspects techniques des programmes principaux du concours, « Sécurité pour l'IA » et « Bataille de piratage d'IA ». Les questions de cette année se sont étendues au-delà des vulnérabilités LLM textuelles pour englober des scénarios de menaces réels pouvant survenir dans des systèmes d'IA multimodaux basés sur des agents.

L'épreuve phare du concours, la « Bataille de piratage IA », consistait à faire concevoir aux équipes leurs propres garde-fous et systèmes d'IA, puis à attaquer et défendre les systèmes de l'équipe adverse en temps réel. Cela a permis aux participants de se familiariser rapidement avec les stratégies d'attaque et de défense propres à un environnement industriel réel et de tester leurs capacités de réaction.

Les problèmes présentés consistaient en une attaque provoquant le dysfonctionnement de drones IA par le biais d'entrées adverses visuelles, la conception d'un pot de miel pour un agent, le développement d'un agent effectuant une attaque de jailbreak automatique en plusieurs étapes, un scénario incitant un système autonome à prendre la mauvaise direction, une attaque d'exfiltration de données volant des clés privées et une attaque extrayant des informations sensibles en forçant l'appel d'outils internes limités.

Un représentant d'Aim Intelligence a expliqué : « Nous avons conçu le problème pour refléter les risques qui peuvent réellement survenir dans les services d'IA multimodaux basés sur des agents. »

Par ailleurs, lors de la première journée de l'événement, le PDG Yoo Sang-yoon a participé en tant que modérateur officiel du « Séminaire sur les enjeux de sécurité de l'IA », présentant les problèmes de sécurité et les dernières tendances qui émergent lors du processus d'adoption de l'IA par les entreprises et organisations du monde entier, et animant des discussions avec les intervenants.

Aim Intelligence mène des recherches sur la normalisation de la sécurité de l'IA et une collaboration technologique avec l'Artificial Intelligence Security Institute (AISI), le Financial Security Institute et le Korea Credit Information Services, et renforce également sa coopération mondiale en tant que partenaire local d'OpenAI pour la sécurité de l'IA.

Le PDG Yoo Sang-yoon a déclaré : « C’est très important car cela peut contribuer à renforcer l’écosystème de sécurité de l’IA au niveau national », et a ajouté : « Nous allons accélérer le développement de technologies pour répondre aux menaces qui s’étendent aux domaines des agents multimodaux et autonomes. »

- Voir plus d'articles connexes

You must be logged in to post a comment.